La tecnologia d’efectes especials ha experimentat un autèntic boom en les darreres dècades, amb CGI que passa de rudimentàriament crua i primitiva a gairebé indistingible de la realitat. Ara, a mesura que la creació d’imatges verosimilitudinoses esdevé cada vegada més comuna, els experts polítics i els experts en justícia penal anticipen un pànic al voltant de l’anomenada tecnologia “falsa profunda”, que té el potencial de complicar encara més una discussió internacional en curs sobre les “falses notícies”. Però, què és, exactament, una 'falsificació profunda' i quina amenaça suposarà aquesta tecnologia en el futur?

La tecnologia de falsificació profunda (de vegades estilitzada com a 'deepfake') fa referència a imatges i / o vídeos sintetitzats i / o superposats creats per intel·ligència artificial mitjançant imatges i vídeos existents. Mitjançant l’aprenentatge automàtic, aquesta tecnologia podria, teòricament, crear imatges convincents d’una persona que realitza un acte que mai no s’ha produït a la vida real.

Owen Williams, enginyer de programari professional i artista d’efectes visuals, va oferir una explicació senzilla.

'És una manera d'utilitzar un sistema de programari automatitzat per substituir la cara d'una persona en un vídeo per una altra que és molt més automàtica i convincent del que s'havia pogut fer amb la tecnologia passada', va dir Williams. Oxygen.com .

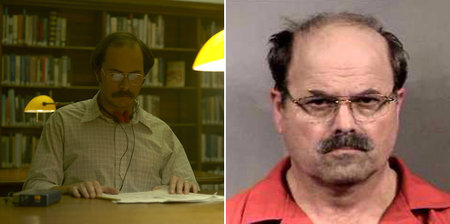

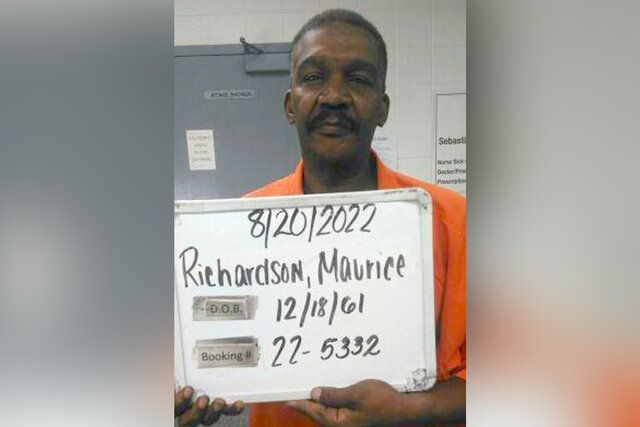

com enquadrar algú per assassinat

Williams va assenyalar que pel·lícules populars i populars com 'Jurassic Park' i 'Blade Runner: The Final Cut' utilitzaven programes informàtics per a determinades escenes de maneres que podrien haver estat un precursor de falsificacions profundes: 'A la indústria del cinema, això és realment habitual. Suposem que teniu un personatge que ha de realitzar un truc i preferiu que la seva cara sigui visible. La solució clàssica seria que només els veieu per darrere o els cabells els quedarien a la cara, de manera que no podríeu dir que era un doble. Però hi ha una història força implicada de cineastes que utilitzen ordinadors per posar la cara d'un actor sobre la de dobles de trucs '.

'Abans era un procés molt manual', va continuar Williams. Ara, amb una tecnologia falsa profunda, alimentes dues coses a l'ordinador: primer el vídeo que reemplaçaràs i, després, un munt d'entrades de la cara amb què reemplaçaràs. Heu d’obtenir prou imatges d’una persona que faci expressions facials diferents i des de diferents angles. Esteu creant una biblioteca de com pot semblar el rostre d’aquesta persona en diferents situacions i, a continuació, l’ordinador passa i mira el vídeo. Tampoc no necessita una coincidència exacta. Pot aixafar i transformar el que té a la biblioteca per adaptar-se al que necessita. El que solia requerir dotzenes d’artistes centenars d’hores per intentar executar un efecte realment complicat ara és només prémer un botó ”.

Una de les facetes d’aquesta tecnologia que preocupa a la gent és que una persona no necessàriament ha de presentar la seva cara de bon grat perquè aquest procés s’executi, tenint en compte quantes imatges hi ha en línia de la majoria de la gent, sobretot de personatges famosos i polítics.

per què Bruce Kelly és a la presó?

'Hi ha prou fotografies de qualsevol celebritat amb prou angles per poder crear aquesta biblioteca [sense consentiment]', va dir Williams. 'Es necessita una certa quantitat de treball per fer-ho, però per a qualsevol figura marginalment popular hi haurà coses. Tinc la sensació que és menys probable que això sigui el més possible per a una persona normal '.

Els primers vídeos falsos profunds van aparèixer als fòrums de Reddit a finals de 2017, segons Variety . Un usuari va afirmar haver utilitzat el seu ordinador per crear vídeos pornogràfics molt realistes de diverses celebritats dedicades a activitats sexuals que mai van passar realment a la vida real. L'usuari va afirmar que va alimentar al seu ordinador milers de fotos de les estrelles, a partir de les quals la IA podia obtenir les expressions i els moviments facials representats. Una aplicació utilitzada per creadors falsos profunds i compartida a Reddit va ser finalment descarregada més de 100.000 vegades. (Reddit acabaria prohibint aquest tipus de contingut, dient que infringia la seva política de 'pornografia involuntària') segons The Verge .)

Williams dubta del realisme que aquest mitjà pot assolir en aquest moment.

'Si realment heu vist alguna d'aquestes falsificacions profundes ... hi ha una certa estranyesa', va dir Williams. No estan polits. Però, probablement, cada cop serà millor, sobretot perquè Hollywood té interès a fer-ho automatitzat en lloc de pagar artistes cars ”.

De la mateixa manera, Williams ho va endevinar malgrat això el pànic al voltant del porno fals fals , el canvi d’actituds culturals al voltant de la naturalesa de coses com la pornografia de venjança o les imatges de nus filtrats significa que és probable que les persones que creen aquest tipus de mitjans siguin condemnades i no celebrades, fins i tot dins de la indústria de l’entreteniment per a adults.

noi del rei tigre sense potes

'Mai serà general', va teoritzar Williams. 'Després' The Fappening 'Va passar la cosa a Reddit, la gent va poder canviar la conversa i va dir:' Això no és un escàndol, és un delicte sexual '. Per tant, no veig que això esdevingui un escàndol tant com la gent creu que ho farà. La gent també pot trobar el porno original a partir del qual es va crear la falsificació profunda, cosa que significa que és bastant fàcil de desmentir.

Però no només causa preocupació, ja que es podria utilitzar per crear porno falsos de celebritats. La gent també està preocupada per les ramificacions polítiques.

Els experts polítics van començar a escriure sobre la proliferació de falsificacions profundes el 2018. Un article de Guardian des del novembre d'aquell any es va notar la difusió viral d'un vídeo que suposadament representava el president Donald Trump animant la nació de Bèlgica a retirar-se de l'Acord de París sobre el clima. Això va catalitzar una discussió més àmplia sobre el potencial per a diversos governs d’utilitzar aquesta tecnologia en campanyes massives de desinformació, una conversa que ja s’havia iniciat gràcies a la investigació en curs sobre la participació de Rússia a les eleccions presidencials dels Estats Units del 2016.

El pànic al voltant de falsificacions profundes fins i tot va inspirar el consell editorial de Bloomberg Media Group a escriure una opinió fortament redactada al respecte.

t'estimo a la mort història real

'Les proves en vídeo s'han convertit en un pilar del sistema de justícia penal ... precisament perquè la pel·lícula sembla un registre tan fiable del discurs o les accions d'algú. Falses profundes podrien fer possible que aquestes proves siguin sospitoses. van escriure al juny del 2018. 'Per tant, un repte primordial serà identificar i cridar aquestes falsificacions, si és possible'.

Williams va estar d'acord que la naturalesa de falsificacions profundes amenaça les nostres nocions de 'realitat' pel que fa a proves de vídeo, però va assenyalar que aquest embolic legal no és exclusiu del nostre panorama digital contemporani.

'Es deu a aquesta idea que la gent té aquest vídeo igual a la veritat, cosa que mai no ha estat així. Ho sabíem des de Rodney King en endavant. O, pensa-ho Eric Garner : La gent pensava que [l'oficial que el va matar] era innocent, independentment del vídeo predit de l'incident. A mi [moltes de les pors al voltant de falsificacions profundes] em semblen una mica infundades ”.

Williams va enumerar diversos altres incidents que no impliquen una tecnologia falsa profunda que mostrava la manera com el vídeo ha estat manipulat amb valentia per esbiaixar l'opinió pública sobre un assumpte, com Controvertida eliminació d'ACORN per James O'Keefe i un recent escàndol relacionat vídeo doctorat que suposadament representava el periodista de la CNN Jim Acosta atacant un empleat de la Casa Blanca .

La conclusió final de Williams va ser que la histèria que envolta les falsificacions profundes està una mica desbordada.

'El que veig que passa és que funcionarà en tots dos sentits. Si surt un vídeo i és real, la gent afirmarà que és fals. Si surt un vídeo i és fals, la gent afirmarà que és real. Cada cas suposa una certa quantitat de veritat assignada al vídeo [per si mateix]. És difícil saber en quina direcció es dirigirà tot això The Pee Tape en realitat va sortir, per exemple, ja sabeu exactament què passaria: la meitat de la gent deia: 'Això són bous, és un actor!' i la meitat de la gent deia: 'Aquí està! És real!' Per tant, res no canviaria realment. Això acostuma a ser el que passa amb les noves tecnologies: les coses no canvien tant com la gent pensa ».

[Foto: SAUL LOEB / AFP / Getty Images]