Cada any es denuncien aproximadament 7 milions de nens a les autoritats de benestar infantil per possibles abusos, però com determinen les autoritats si els agrada als nens Gabriel Fernandez estan en greu perill i necessiten intervenció?

Moltes autoritats de benestar infantil es basen en les avaluacions de risc que ofereixen els funcionaris formats per atendre les línies telefòniques on es denuncien sospites d'abús, però hi ha qui creu que hi pot haver una manera millor.

'Hi ha una àmplia literatura que hem vist que suggereix que els humans no són especialment bons de cristall', va dir Emily Putnam-Hornstein, directora del Xarxa de dades infantils i un professor associat a la USC, deia a la nova sèrie docu Neflix 'Els judicis de Gabriel Fernández'. 'En canvi, el que diem és que formem un algoritme per identificar quins d'aquests nens s'adapten a un perfil on el risc d'arc llarg suggeriria la participació del sistema en el futur'.

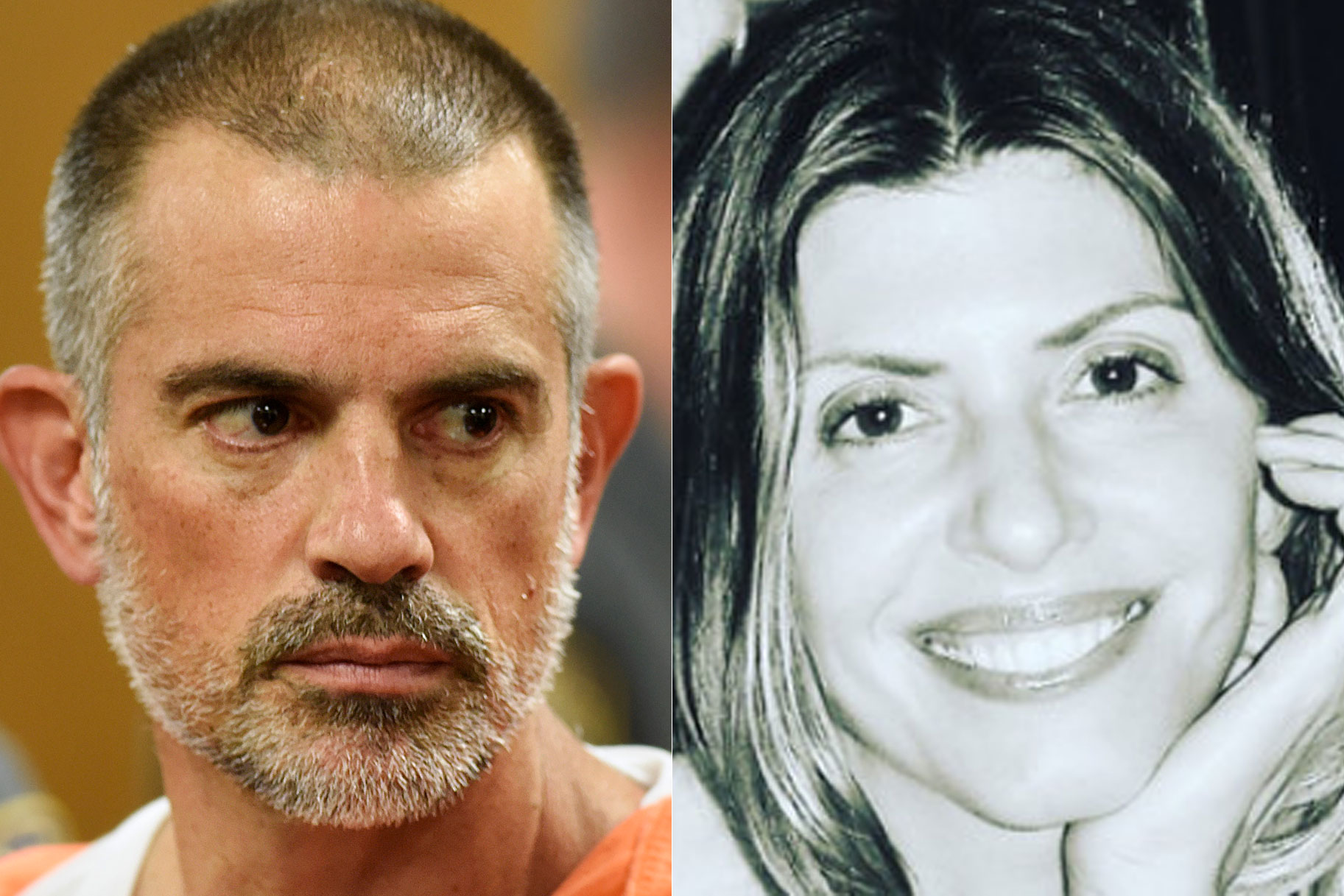

Fernández era un nen de vuit anys apallissat i torturat pels seus mare i ella nuvi , malgrat les reiterades trucades del seu professor i d'altres a les autoritats que van denunciar presumptes abusos. La nova sèrie de sis parts examina la vida i la mort horrible de Fernandez, però també fa una mirada més àmplia problemes sistèmics dins del sistema de benestar infantil que podria haver tingut un paper.

Ted Cruz és l'assassí del zodíac

Putnam-Hornstein argumenta que una estratègia per identificar amb més eficàcia els nens amb més risc podria ser l’ús d’algoritmes especialment creats que utilitzen registres administratius i mineria de dades per determinar les puntuacions de risc de cada nen.

'En realitat, tenim al voltant de 6 o 7 milions de nens que es denuncien per presumpte abús o negligència cada any als Estats Units i històricament la forma en què hem pres algunes de les nostres decisions de detecció només es basa en una mena de valoracions intestinals', va dir. 'La modelització predicta del risc només diu:' No, no, no, adoptem un enfocament més sistemàtic i empíric en aquest sentit '.

Putnam-Hornstein i Rhema Vaithianathan, el codirector del Centre d'Anàlisi de Dades Socials , van poder posar en pràctica la idea al comtat d'Allegheny, Pennsilvània. La parella va utilitzar milers de referències de maltractament infantil per dissenyar un algorisme que determinaria una puntuació de risc per a cada família reportada als serveis de protecció infantil del comtat, segons el Centre de Periodisme Sanitari .

noia a l'armari episodi complet

'S'analitzen un centenar de factors diferents', va explicar Marc Cherna, director del departament de serveis humans del comtat d'Allegheny, a la sèrie docu. 'Alguns exemples bàsics són la història del benestar infantil, la història dels pares, sens dubte el consum de drogues i l'addicció, la malaltia mental familiar, la presó i les condemnes, i sobretot si hi ha agressions i coses per l'estil'.

A causa del gran volum de trucades, les autoritats de benestar infantil de tot el país tenen la tasca de determinar si una família ha de ser investigada per investigar-la segons la denúncia o si ha de ser eliminada.

El 2015, segons el comunicat, es va examinar el 42% dels 4 milions d’al·legacions rebudes a tot el país relacionades amb 7,2 milions de nens El New York Times .

Tot i així, els nens continuen morint a causa de l’abús infantil.

El sistema que s’utilitza al comtat d’Allegheny està dissenyat per predir amb més precisió quines famílies és probable que tinguin implicació futura en el sistema mitjançant l’anàlisi de dades.

'El que tenen els investigadors són moltes dades', va dir Vaithianathan a The Times. 'Però, és bastant difícil navegar i saber quins són els factors més importants. Dins d’una única trucada a C.Y.F. , és possible que tingueu dos fills, un presumpte autor, que tingueu mare, que pugueu tenir un altre adult a la llar; totes aquestes persones tindran antecedents al sistema que la persona que examina la trucada pugui investigar. Però el cervell humà no és tan hàbil per aprofitar i donar sentit a totes les dades ”.

L'eina de detecció de la família Allegheny utilitza una tècnica estadística anomenada 'mineria de dades' per examinar els patrons històrics per 'intentar fer una predicció del que podria passar' en qualsevol cas, va dir a la docu-series.

A cada cas se li dóna una puntuació de risc que oscil·la entre un i un vint, classificant cada cas com a risc alt, risc mitjà o risc baix.

ted bundy darreres paraules abans de la mort

Rachel Berger, pediatra de l’Hospital Infantil de Pittsburgh, va dir a The Times el 2018 que el que fa valuosa l’anàlisi predictiva és que elimina part de la subjectivitat que normalment s’inicia en el procés.

'Tots aquests nens viuen en el caos', va dir. “Com funciona C.Y.F. triar quins són els més perillosos quan tots tenen factors de risc? No us podeu creure la quantitat de subjectivitat que entra en les decisions de protecció de menors. Per això, m’encanten les analítiques predictives. Finalment, aporta certa objectivitat i ciència a decisions que poden canviar la vida de manera increïble '.

Però també hi ha hagut crítics que argumenten que l’ús de l’anàlisi predictiva es basa en dades que ja poden estar esbiaixades. Les investigacions anteriors han demostrat que les minories i les famílies amb pocs ingressos sovint estan sobrerepresentades en les dades que es recopilen, creant potencialment un biaix contra les famílies afroamericanes o altres famílies minoritàries, segons la docu-series.

“Els biaixos humans i els biaixos de dadesanar de la mà els uns amb els altres', Va dir Kelly Capatosto, investigadora associada a l'Institut Kirwan per a l'Estudi de la Raça i l'Ètnicitat de la Universitat Estatal d'Ohio, segons el Centre de Periodisme Sanitari. 'Amb aquestes decisions, pensem en la vigilància i el contacte del sistema, amb la policia, les agències de protecció de la infància i qualsevol agència que presta servei al benestar social. Es representarà excessivament a les comunitats (de renda baixa i minoritària). No és necessàriament indicatiu d’on tenen lloc aquestes instàncies '.

Erin Dalton, subdirectora de l’oficina d’anàlisi, tecnologia i planificació del comtat d’Allegheny, va admetre que el biaix és possible.

“De ben segur, hi ha biaix als nostres sistemes. Veiem l'abús infantil i les nostres dades no són una funció de l'abús infantil real, sinó que depèn de qui és denunciat ', va dir a la sèrie Netflix.

Però el comtat també va dir al Centre de Periodisme Sanitari que va trobar que rebre beneficis públics redueix les puntuacions de risc que gairebé tenen les seves famílies.

TEl comtat és 'molt sensible' a aquesta preocupació i està fent una anàlisi contínua del sistema per determinar si els grups han estat objectius desproporcionats, també va dir Cherna a la sèrie docu.

on és legal l’esclavitud al món

El sistema del comtat d'Allegheny és propietat del propi comtat, però també hi ha hagut algunes crítiques a altres sistemes de detecció de propietat privada.

El Departament de Serveis a la Infància i la Família d'Illinois va anunciar el 2018 que deixaria d'utilitzar un paquet d'anàlisi predictiu desenvolupat per Eckerd Connects, una organització sense ànim de lucre i el seu soci amb ànim de lucre MindShare Technology, en part perquè l'empresa es va negar a proporcionar detalls de quins factors s’utilitzaven en la seva fórmula, segons The Times.

Segons els informes, el sistema va començar a designar milers de nens que necessitaven protecció urgent, donant a més de 4.100 nens d'Illinois una probabilitat de mort o lesió del 90% o més, El Chicago Tribune reportat el 2017.

Tot i això, altres nens que no van rebre puntuacions d’alt risc encara van acabar morint per abús.

'L'anàlisi predictiva (no predia) cap dels casos dolents', va dir Beverly, directora del Departament de Serveis a la Infància i la Família, Beverly 'B.J.' Walker li va dir a la tribuna. 'He decidit no continuar amb aquest contracte'.

és la història real de la matança de la motoserra de Texas

Daniel Hatcher, autor de ' La indústria de la pobresa: l’explotació dels ciutadans més vulnerables d’Amèrica 'Va comparar alguns dels sistemes analítics amb una' caixa negra ', dient a la sèrie de documents que no sempre és clar com prenen les seves decisions.

'No tenen manera d'esbrinar com estan decidint realment un nivell d'atenció que té un gran impacte en una persona', va dir.

Putnam-Hornstein va reconèixer que els sistemes analítics predictius no són capaços de determinar el comportament futur, però creu que és una eina valuosa que permet als examinadors prendre decisions més informades sobre quins nens poden tenir més risc.

'Espero que aquests models ajudin el nostre sistema a prestar més atenció al subconjunt relativament petit de referències on el risc és particularment elevat i podrem dedicar més recursos a aquests nens i famílies de manera preventiva', va dir, segons al Centre de Periodisme Sanitari. 'No vull que ningú sobrevenda models predictius de risc. No és una bola de cristall. No solucionarà tots els nostres problemes. Però, al marge, si ens permet prendre decisions lleugerament millors i identificar els casos d’alt risc i separar-los dels casos de baix risc i ajustar-los en conseqüència, això podria ser un desenvolupament important al camp ”.